专栏名称: 机器之心

| 专业的人工智能媒体和产业服务平台 |

今天看啥

微信公众号rss订阅, 微信rss, 稳定的RSS源

目录

相关文章推荐

|

宝玉xp · 转发微博-20240422135404· 昨天 |

|

爱可可-爱生活 · 【Elon Musk 称赞 Meta 的 ...· 2 天前 |

|

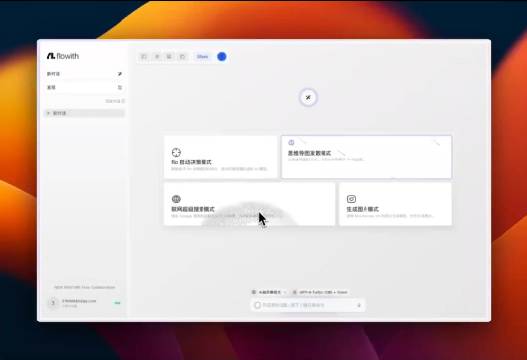

黄建同学 · 发现一个比较有创意的AI大模型交互flowi ...· 2 天前 |

|

宝玉xp · //@雪夜怪谈:提到的文明系列书单在这:网页 ...· 5 天前 |

|

宝玉xp · 转发微博-20240418000907· 6 天前 |

推荐文章

|

宝玉xp · 转发微博-20240422135404 昨天 |

|

宝玉xp · 转发微博-20240418000907 6 天前 |

|

TeacherGwen · 最后 3天报名! 1 年前 |

|

HR成长社 · 2022薪酬报告.pdf 1 年前 |

|

NutSpace · 2021,感谢所有的遇见 2 年前 |

|

证券市场红周刊 · 低估值个股年底迎来补涨行情 4 年前 |