专栏名称: 新智元

| 智能+中国主平台,致力于推动中国从互联网+迈向智能+新纪元。重点关注人工智能、机器人等前沿领域发展,关注人机融合、人工智能和机器人革命对人类社会与文明进化的影响,领航中国新智能时代。 |

今天看啥

微信公众号rss订阅, 微信rss, 稳定的RSS源

目录

相关文章推荐

|

宝玉xp · OpenAI 默认的 Function ...· 昨天 |

|

爱可可-爱生活 · 几篇论文实现代码:《Towards ...· 昨天 |

|

爱可可-爱生活 · 通过归纳文本与情感的因果机制,指导构建对齐的 ...· 3 天前 |

|

机器之能 · 开源大模型Llama ...· 5 天前 |

推荐文章

|

芯东西 · 昨晚,拜登让美国芯片法案正式生效! 1 年前 |

|

午夜超人快聘 · 正月初十 广州 各地区 热门 招聘 2 年前 |

|

粮油世界 · 磨粉机对光辊技术特性的要求 2 年前 |

|

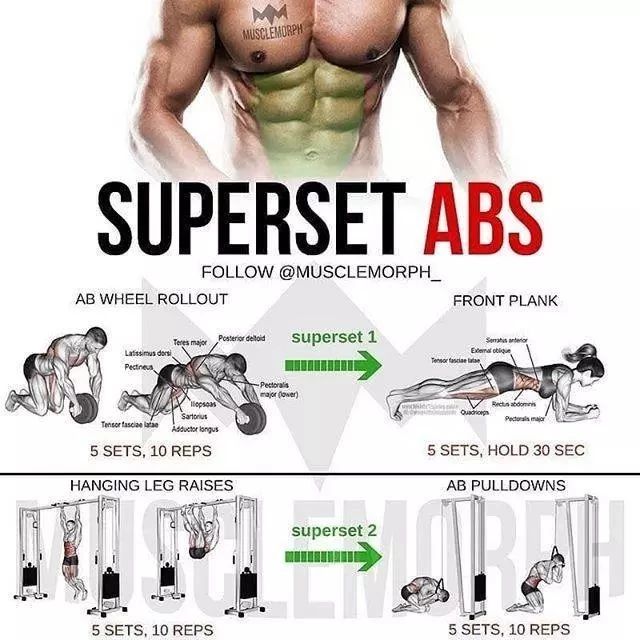

爱健身 · 6张图告诉你,全身各部位最基础的训练动作,男女通用! 4 年前 |