专栏名称: AINLP

| 关注AI、NLP相关技术,关注算法研发职位和课程;回复"文章"获取历史信息;双语聊天机器人"无名";中英翻译请输入:翻译 翻译内容;自动对联,请输入:上联 上联内容;调戏夸夸聊天机器人,请求夸、求赞;查询相似词,请输入: 相似词 词条 |

今天看啥

微信公众号rss订阅, 微信rss, 稳定的RSS源

目录

相关文章推荐

|

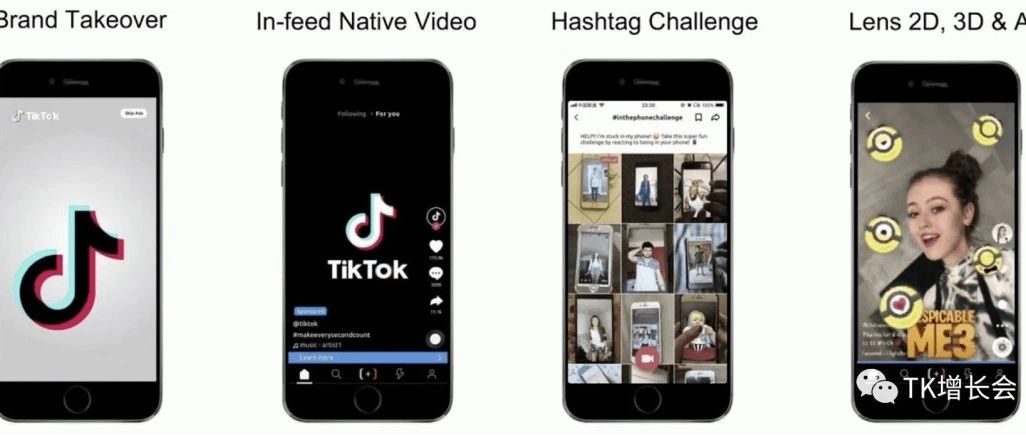

品牌出海海贸会 · Tik Tok广告值不值得投?· 昨天 |

|

品牌出海海贸会 · 泼天富贵!TiktoK美国小店大信息!· 1 周前 |

|

雨果网 · 2024美客多品类数据报告:4大国家站点深挖 ...· 3 天前 |

|

雨果网 · 直接吓退!亚马逊“炮灰”岗位也要求名校毕业?· 3 天前 |

|

雨果网 · 安克又成吸金王!跨境大卖年度成绩单· 6 天前 |

推荐文章

|

品牌出海海贸会 · Tik Tok广告值不值得投? 昨天 |

|

品牌出海海贸会 · 泼天富贵!TiktoK美国小店大信息! 1 周前 |

|

雨果网 · 直接吓退!亚马逊“炮灰”岗位也要求名校毕业? 3 天前 |

|

雨果网 · 安克又成吸金王!跨境大卖年度成绩单 6 天前 |

|

商业咔 · 松江印象城完整探班报告 2 年前 |

|

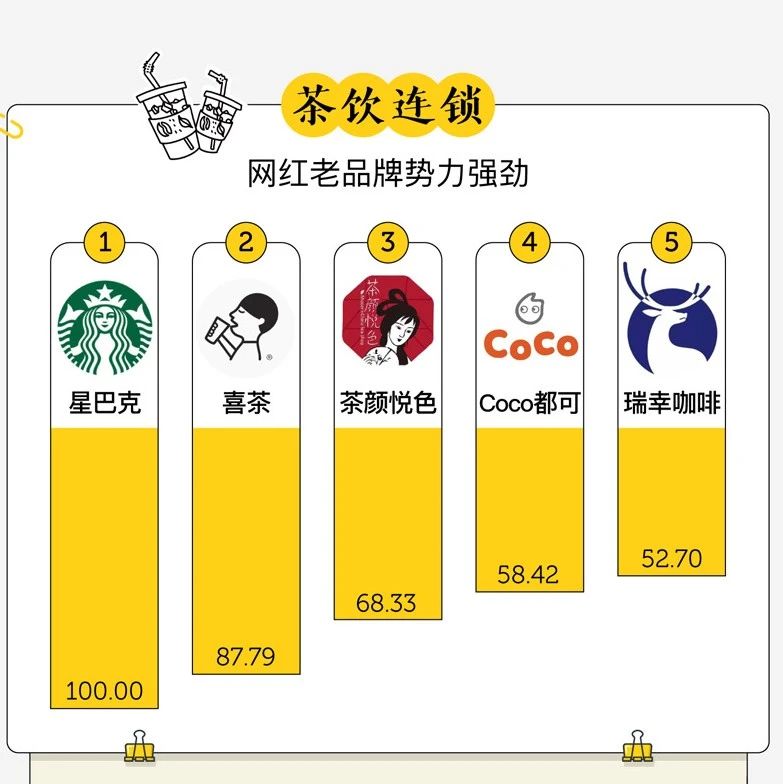

创业财闻汇 · 中国人最爱的品牌,都在这了 3 年前 |

|

夜听 · 无法重来的一生,要这样爱自己 3 年前 |