专栏名称: 高能AI

| 高能量的AI算法集散地、转运站! |

今天看啥

微信公众号rss订阅, 微信rss, 稳定的RSS源

目录

相关文章推荐

|

教你驾驭男人 · “我五年前就结扎了,你怎么可能怀。”她如雷轰 ...· 2 天前 |

|

三峡小微 · 国货潮牌,“绿色”三峡不缺位· 3 天前 |

|

彬彬有理 · 白天是“导游”,晚上是“妻子”!交易曝光, ...· 3 天前 |

|

教你驾驭男人 · “王爷,听说夫人是武林高手,您怕她吗?”“怕 ...· 4 天前 |

|

三峡小微 · 韩君在湖北能源清江公司调研防洪度汛及安全生产工作· 4 天前 |

推荐文章

|

三峡小微 · 国货潮牌,“绿色”三峡不缺位 3 天前 |

|

彬彬有理 · 白天是“导游”,晚上是“妻子”!交易曝光,毁三观…… 3 天前 |

|

三峡小微 · 韩君在湖北能源清江公司调研防洪度汛及安全生产工作 4 天前 |

|

HR成长社 · 腾讯人才盘点逻辑图.ppt 3 周前 |

|

财融圈 · 终止审核!IPO申报之后,合伙人员工离职率却上升 11 月前 |

|

投行精英社 · 中国民营企业百强排行榜2023 1 年前 |

|

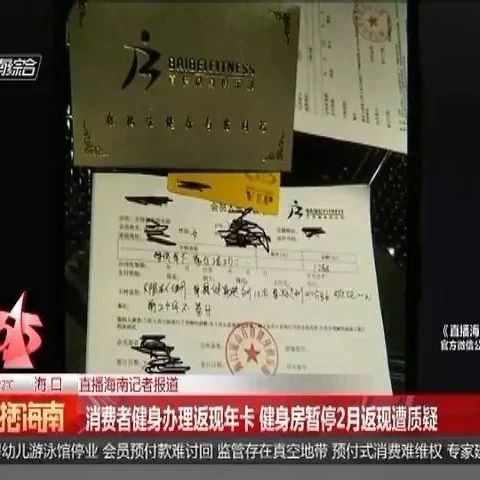

直播海南 · 消费者健身办理返现年卡,健身房暂停2月返现遭质疑 5 年前 |